Introducción al Perceptrón

El perceptrón es el modelo más básico de una neurona artificial, constituyendo la unidad fundamental en las redes neuronales artificiales. Fue introducido por Frank Rosenblatt en 1957 como un algoritmo de aprendizaje supervisado para tareas de clasificación binaria. Su objetivo principal es discernir entre dos categorías distintas mediante la aplicación de un conjunto de pesos a las entradas y la evaluación de una función de activación.

Estructura y Funcionamiento Técnico

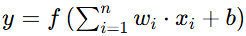

Un perceptrón procesa múltiples entradas x1,x2,…,xn, cada una asociada a un peso correspondiente w1,w2,…,wn. Además, incluye un sesgo b que permite ajustar la salida del modelo independientemente de las entradas. La salida yyy del perceptrón se determina mediante la siguiente expresión matemática:

Aquí, f representa la función de activación, que suele ser una función escalón que produce una salida binaria, como 0 o 1, dependiendo de si la suma ponderada supera un umbral específico.

Ejemplo Práctico: Clasificación de Correos Electrónicos

Para ilustrar el funcionamiento del perceptrón, consideremos un ejemplo sencillo: la clasificación de correos electrónicos como «spam» o «no spam». Supongamos que disponemos de un conjunto de datos donde cada correo electrónico se representa mediante dos características:

- Frecuencia de palabras clave: número de veces que aparecen palabras comúnmente asociadas al spam.

- Presencia de enlaces: número de enlaces presentes en el correo.

Asignamos las siguientes entradas:

- x1: Frecuencia de palabras clave.

- x2: Número de enlaces.

El perceptrón asignará pesos w1 y w2 a estas características, respectivamente, y calculará una suma ponderada de las entradas. Si esta suma supera un umbral determinado por el sesgo b, el perceptrón clasificará el correo como «spam» (por ejemplo, salida = 1); de lo contrario, lo clasificará como «no spam» (salida = 0).

Limitaciones y Evolución

Aunque el perceptrón es eficaz para resolver problemas donde las clases son linealmente separables, presenta limitaciones al enfrentar problemas más complejos. Por ejemplo, no puede resolver el problema lógico XOR, donde las clases no son linealmente separables. Esta limitación llevó al desarrollo de perceptrones multicapa o redes neuronales multicapa, que incorporan una o más capas ocultas entre las entradas y la salida. Estas estructuras más complejas permiten a las redes neuronales abordar problemas no lineales mediante el uso de funciones de activación no lineales y algoritmos de aprendizaje más avanzados, como el retropropagación del error.

Conclusión

El perceptrón ha sido fundamental en el desarrollo de la inteligencia artificial y el aprendizaje automático. Aunque su simplicidad limita su aplicabilidad en problemas complejos, sentó las bases para el diseño y comprensión de modelos más avanzados en redes neuronales. La evolución desde el perceptrón simple hasta las redes neuronales profundas actuales demuestra la importancia de este modelo en la historia de la computación y la inteligencia artificial.